Как продвинуть сайт в Google - 3 причины, которые могут помешать

Есть ситуация, знакомая многим SEO-специалистам: сайт системно растет в Яндексе, выполняются все классические работы, а Google не реагирует вообще, как будто оптимизации на сайте не существует.

Именно это произошло с одним из наших клиентов - порталом недвижимости.

- GPSI держался на уровне 90,

- ссылочное закупалось регулярно,

- была развернута сеть сателлитов на дроп-доменах,

- микроразметка внедрена максимально широко,

- контент и перелинковка на хорошем уровне.

По всем видимым параметрам - образцовая работа, которая Google по какой-то причине не нравилась.

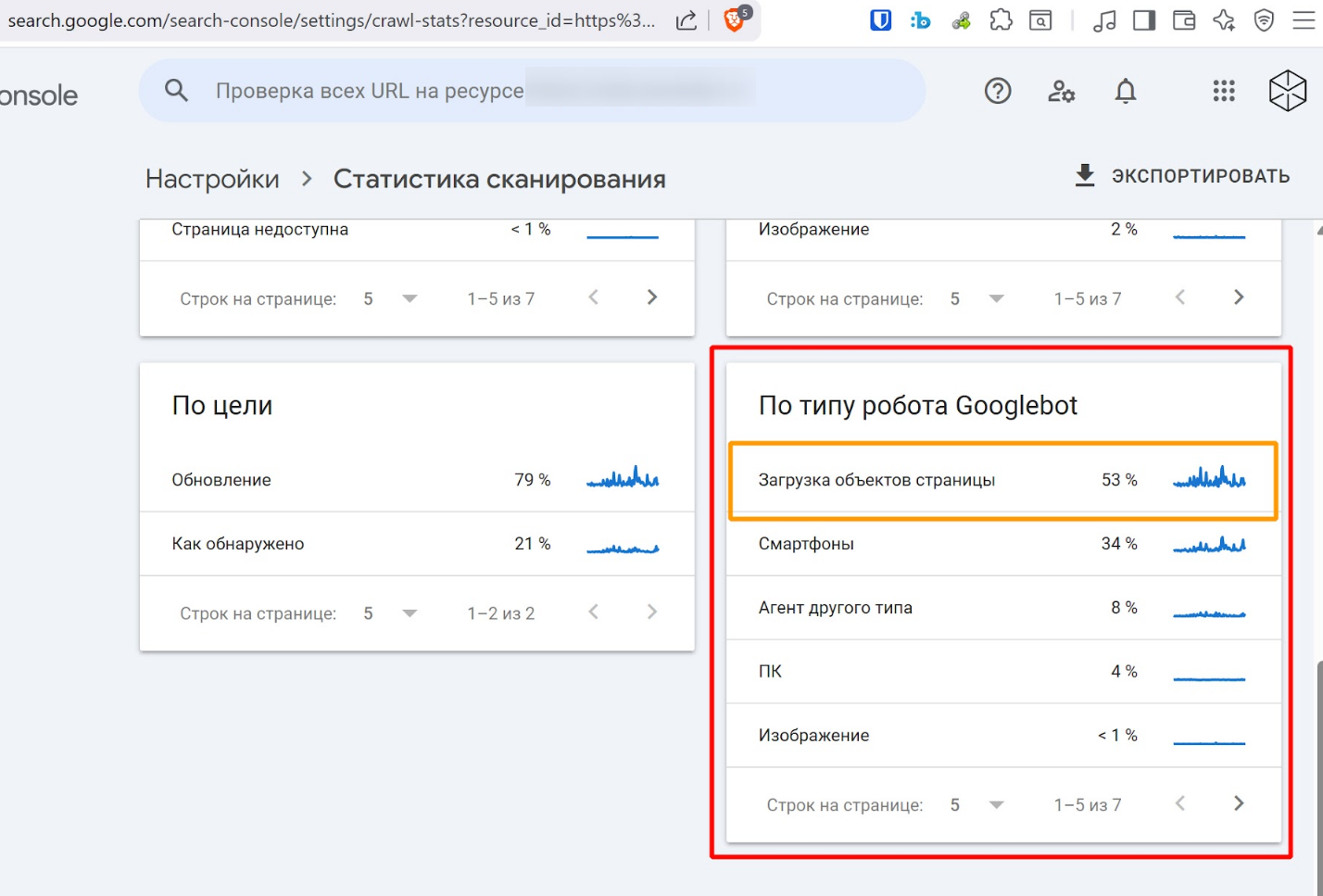

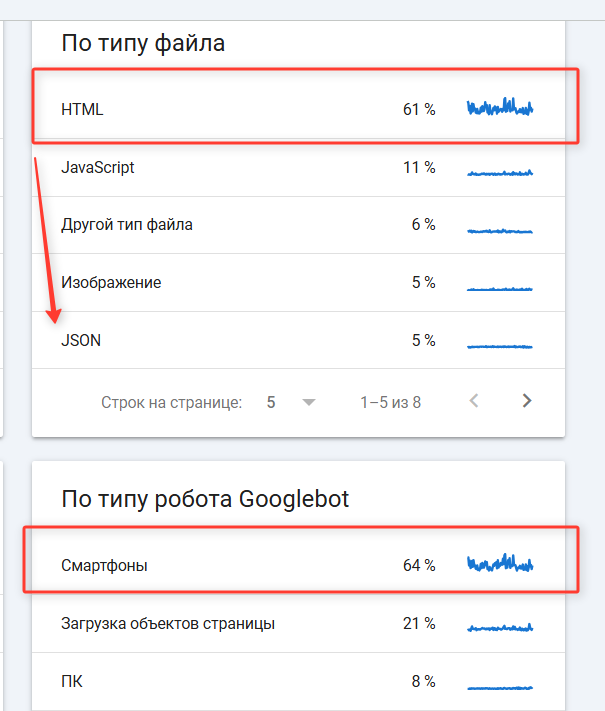

Решение нашли в неожиданном месте: в блоке «Статистика сканирования» в Google Search Console. В разделе «Распределение запросов на сканирование по типу файла» мы увидели, 60% ресурсов уходило на «загрузку объектов страницы» при норме в 10-15%.

Google тратил ресурсы на обработку больших массивов JSON-данных, не имеющих ценности для индексации, и физически не добирался до важного контента, который как и положено транслировался в HTML.

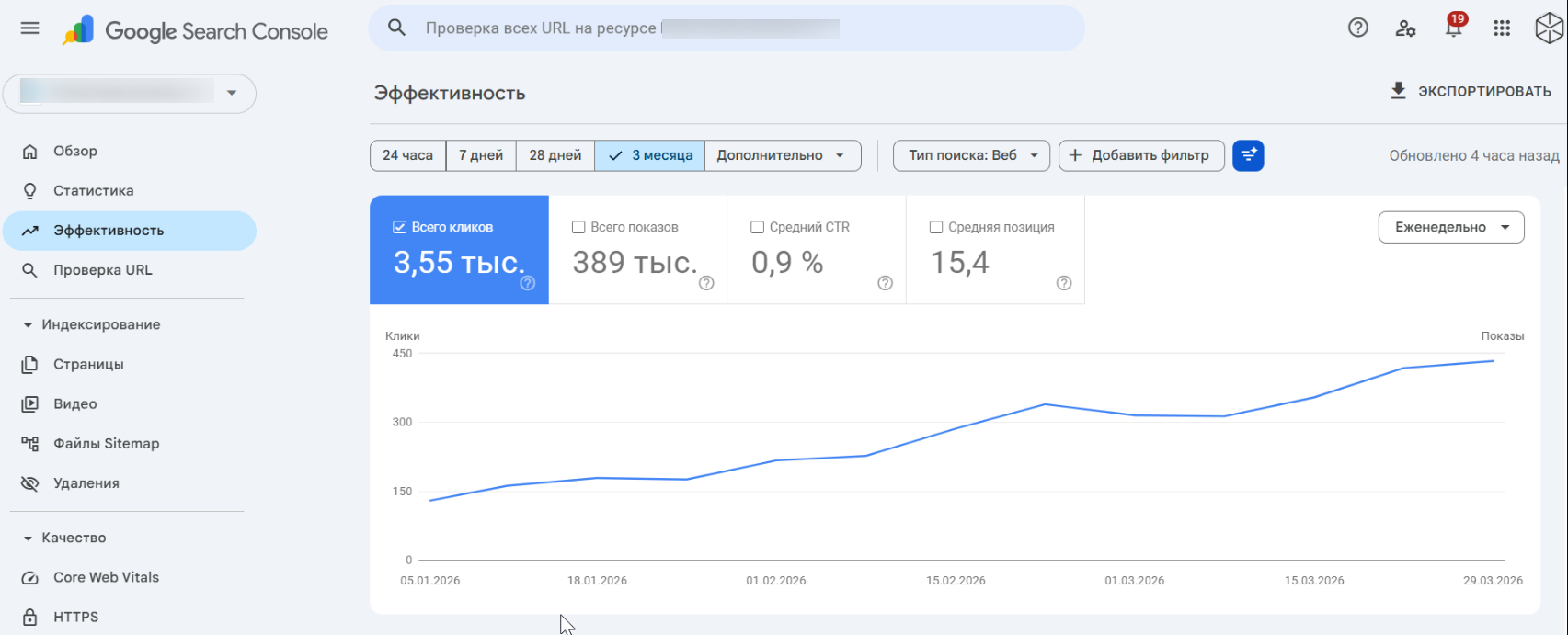

После зачистки лишних JSON-структур ситуация изменилась быстро.

По сути, мы указали Google - «не трать время на это, а смотри вот сюда - на HTML контент». Спустя месяц картина распределения краулингового бюджета изменилась так, как нам было нужно. Показательно, что в разделе «Эффективность» трафик, показы и средняя позиция сайта начали расти.

Но этот случай - лишь один из системных факторов, которые в 2026 году определяют успех продвижения в Google.

EEAT и реальная экспертиза: Google хочет знать, кто написал ваш текст

Google все настойчивее требует реальную фигуру, отвечающую за контент. Рост значения факторов EEAT (Experience, Expertise, Authoritativeness, Trustworthiness) стал прямым ответом на лавину нейросетевых текстов, которые технически грамотны, но анонимны и не несут реальной ответственности за его содержимое.

Важно находить или создавать и последовательно прокачивать профили экспертов:

- делать публикации в авторитетных изданиях,

- упоминаться в профессиональных сообществах,

- и т.д.

При этом нейросети из работы не исчезают. Последние обновления алгоритмов показывают: хорошо написанный и отредактированный с помощью AI текст Google вполне признает и ранжирует в ТОПе годами. Проблема не в инструменте, а в подходе: SEO с генерацией тысяч текстов в день работает только до ближайшего апдейта, и только в нишах с экстремальной маржинальностью, где можно заработать за недели и начать заново. Для устойчивого роста это не стратегия.

Ссылочный профиль по-прежнему крайне важен

Ссылочное не только не теряет актуальность, оно становится важнее. Парадокс в том, что именно потому, что все остальное выровнялось. Когда у всех сайтов в нише зеленый PageSpeed Insights, вычищенные тексты и метаданные, корректная структура, присутствуют все возможные блоки на страницах - ссылочный профиль остается единственным показателем, которым можно реально отличиться от конкурентов.

Ключевое требование к ссылкам при этом изменилось: важно делать их качественно, чтобы донорская страница сама стояла в ТОПе по запросам и имела реальный трафик. Ссылка со страницы-пустышки без органического присутствия несет минимальный вес. Ссылка с авторитетной страницы, которую реально читают - совсем другая история.

Технический SEO и краулинговый бюджет: Google экономит ресурсы

Именно эта проблема стояла за кейсом с порталом недвижимости и именно она чаще всего остается невидимой, пока не начать смотреть в нужную сторону. Google становится все более экономным в расходовании ресурсов на краулинг и индексирование.

Упрощенная логика выглядит так:

- ~25% краулингового ресурса уходит на CSS-файлы без корректного кэширования,

- ~25% - на PDF-документы и прочие нецелевые объекты,

- на «качественные тексты для людей» остается лишь половина.

В случае портала недвижимости ситуация была еще острее: 60% бюджета поглощали JSON-массивы, не имеющие индексационной ценности. Техническое SEO помогает Google смотреть в нужную сторону, это было важно и раньше, а сегодня этот фактор становится еще весомее, потому что Google bot стал жестче приоритизировать ресурсы.

На практике это означает:

- периодически проверять блок «загрузка объектов страницы» в Google Search Console,

- ограничивать доступ краулера к нецелевым данным через robots.txt,

- настраивать корректное кэширование статических ресурсов,

- убирать из индексации технические страницы, не несущие ценности.

Вывод

В 2026 году продвижение в Google перестало быть набором базовых чек-листов и превратилось в системную работу с приоритетами: ресурсами краулинга, доверием к контенту и реальной конкурентной дифференциацией.

Практика показывает, что даже идеально «собранный» сайт может не расти, если поисковая система не может эффективно его обходить, не понимает, кто стоит за контентом, и не видит причин выделить его среди аналогичных проектов.

Ключевой вывод: успех в Google - это не сумма отдельных факторов, а их согласованная работа.

- техническая оптимизация должна не просто соответствовать нормам, а направлять краулинговый бюджет в зону ценного контента,

- контент должен быть не просто качественным, а привязанным к реальной экспертизе и подтвержденному авторству,

- ссылочный профиль должен усиливать авторитет за счет реального трафика и веса доноров.

Именно на стыке этих трех направлений и формируется устойчивый рост. Все остальное: скорость, метаданные, структура - уже стало базовым минимумом, без которого просто нельзя.

Если сайт не растет в Google, проблема чаще всего не в отсутствии действий, а в том, что усилия направлены не туда, куда сегодня смотрит поисковая система.